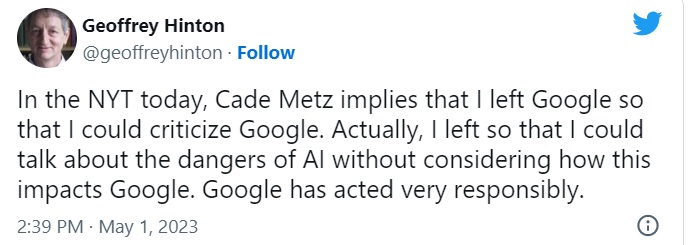

پذیرش هوش مصنوعی بشریت را در معرض خطرات فاجعه باری قرار خواهد داد. در یک اتفاق غیرمنتظره، دکتر جفری هینتون (که به “پدرخوانده هوش مصنوعی” مشهور است) از سمت خود در گوگل استعفا داد تا به طور علنی و آشکارا در مورد خطرات هوش مصنوعی برای بشریت صحبت کند. قبلا ایلان ماسک و بیش از 2600 متخصص حوزه فناوری نیز در مورد خطرات هوش مصنوعی هشدار داده بودند.

هوش مصنوعی بزرگ ترین تهدید برای بشریت

استعفای دکتر هینتون در بحبوحه افزایش نگرانی ها در مورد استفاده از هوش مصنوعی در بخش های مختلف (از جمله بهداشت، امور مالی و حمل و نقل) صورت گرفت. منتقدان استدلال می کنند که هوش مصنوعی می تواند منجر به از بین رفتن برخی مشاغل، نقض حریم خصوصی و حتی توسعه تسلیحات خودکار خارج از کنترل انسان شود.

جفری هینتون در مصاحبهای با نیویورک تایمز اظهار داشت که بیشترین نگرانی وی درمورد استفاده از هوش مصنوعی، پر شدن اینترنت با تصاویر، فیلمها و متنهای ساختگی و دروغین است تا جایی که مردم دیگر نتوانند واقعی را از غیرواقعی تشخیص دهند.

هینتون همچنین نگران جایگزین شدن هوش مصنوعی با نیروی کار انسانی شد. وی معتقد است که هوش مصنوعی به دلیل توانایی در تجزیه و تحلیل حجم عظیمی از دادهها میتواند کارهای غیر منتظره و غافلگیر کننده انجام دهد که این تهدیدی برای بشریت در آینده خواهد بود. هینتون در این مصاحبه به خاطر کارهایی که انجام داده است، ابراز پشیمانی کرد:

من خودم را با این بهانه دلداری می دهم که اگر این کار را نمی کردم، شخص دیگری آن را انجام می داد.

استعفای دکتر جفری هینتون بخش فناوری را شوکه کرد و بسیاری از کارشناسان این حوزه خواستار نظارت و تنظیم قوانین بیشتر برای هوش مصنوعی شدند. همانطور که بحث در مورد خطرات و مزایای هوش مصنوعی ادامه دارد، واضح است که همکاری و کمک افراد پیشگام در این زمینه مانند آقای هینتون در شکل دادن به آینده این فناوری به سرعت در حال تکامل، بسیار مهم خواهد بود.

هشدار بسیاری از کارشناسان فناوری در مورد هوش مصنوعی

در ماه های اخیر، مقامات نظارتی، قانون گذاران و پیشگامان صنعت فناوری، همگی در مورد توسعه هوش مصنوعی ابراز نگرانی کرده اند. بیش از 2600 مدیر فناوری و محقق در ماه مارس نامه سرگشاده ای را امضا کردند که در آن با اشاره به “خطرات جدی هوش مصنوعی برای جامعه و بشریت”، خواستار تعلیق موقت این فناوری شدند.

در ماه آوریل، دوازده قانونگذار اتحادیه اروپا نامه مشابهی را امضا کردند و پیش نویس لایحه اخیر این اتحادیه، ابزارهای هوش مصنوعی را براساس سطح خطر طبقه بندی می کند. علاوه بر این، انگلیس مبلغ 125 میلیون دلار به یک کارگروه برای توسعه “هوش مصنوعی ایمن” اختصاص می دهد.

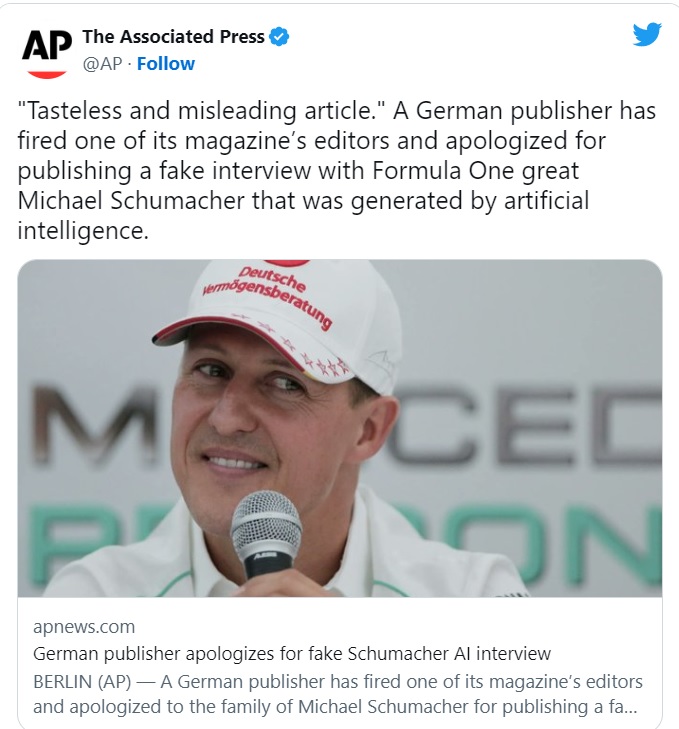

براساس گزارش ها، ابزارهای هوش مصنوعی در حال حاضر برای نشر اطلاعات کاذب و ساختگی استفاده می شوند و اخیرا برخی از سایت های خبری فریب هوش مصنوعی را خورده اند و اخبار کذب منتشر کرده اند. علاوه بر این، یک رسانه آلمانی از هوش مصنوعی برای یک مصاحبه ساختگی استفاده کرده است.

بایننس در اول ماه مه اعلام کرد که یک چت بات تحت هدایت ChatGPT خبری را منتشر کرده مبنی بر این که چانگ پنگ ژائو یکی از اعضای سازمان دانشجویی حزب کمونیست چین بوده است.

هفته گذشته، گروهی از افراد حقه باز چندین رسانه در سراسر جهان، از جمله دیلی میل و ایندیپندنت، را فریب دادند. دیلی میل داستانی در مورد یک بازیگر کانادایی به نام “سنت فون کولوچی” منتشر کرد که گفته می شد پس از عمل جراحی پلاستیک برای شبیه شدن به یک ستاره پاپ کره جنوبی، فوت کرده است. دیلی میل متعاقبا این مقاله را حذف کرد.

برخی از خطرات قابل پیش بینی هوش مصنوعی برای بشریت

هوش مصنوعی چندین خطر قابل پیش بینی برای بشریت دارد که برخی از آنها به وقوع پیوسته اند و برخی دیگر ممکن است در آینده رخ دهند. در ادامه برخی از نگران کننده ترین خطرات این فناوری را بررسی خواهیم کرد:

1. از بین رفتن برخی مشاغل

با پیشرفته تر شدن هوش مصنوعی، احتمال جایگزین شدن این فناوری با نیروی کار انسانی وجود دارد و این منجر به از بین رفتن شغل های زیاد و مشکلات اقتصادی خواهد شد. ایلان ماسک خاطرنشان کرد که مشاغلی وجود دارند که ربات ها می توانند آنها را حتی بهتر از انسان انجام دهند.

2. تسلیحات خودکار خارج از کنترل انسان

توسعه سلاح های خودکار و خارج از کنترل که بدون دخالت انسان می توانند تصمیم بگیرند به چه کسی و در چه زمانی شلیک کنند، یک نگرانی بزرگ است. این نوع سلاح ها می توانند منجر به صدمات ناخواسته ای شوند، چون ممکن است دچار نقص فنی یا هک شوند.

3. پیامدهای ناخواسته

با پیچیده تر شدن سیستم های هوش مصنوعی، این خطر وجود دارد که آنها ممکن است پیامدهای ناخواسته ای را به همراه داشته باشند که می تواند مضر باشد. برای مثال، یک سیستم هوش مصنوعی که برای به حداکثر رساندن سود یک شرکت طراحی شده، می تواند به طور ناخواسته به محیط زیست یا جامعه آسیب برساند.

4. سوگیری و تبعیض

سیستم های هوش مصنوعی فقط به اندازه داده هایی که براساس آنها آموزش دیده اند، بی طرف هستند؛ به این معنی که اگر داده هایی که برای آموزش آنها استفاده می شود متمایل به یک طرف باشد، سیستم هوش مصنوعی نیز سوگیری خواهد داشت. این می تواند عواقب جدی (به ویژه در زمینه هایی مانند عدالت کیفری که سوگیری سیستم های مصنوعی در آنها می تواند باعث حکم ناعادلانه برای گروه های خاصی شود) در پی داشته باشد.

5. خطرات امنیت سایبری

همانطور که سیستم های هوش مصنوعی پیشرفته تر می شوند، در برابر حملات سایبری نیز آسیب پذیرتر می شوند. اگر هکری یک سیستم هوش مصنوعی را هک کند، می تواند از آن برای آسیب رساندن به سیستم های بسیار مهم یا ایجاد اختلال در آنها استفاده کند.

6. عدم شفافیت و پاسخگویی

اگر سیستم های هوش مصنوعی تصمیمات مهمی در مورد زندگی افراد (مانند این که آیا به آنها وام داده می شود یا با وثیقه آزاد می شوند) می گیرند، باید شفاف و پاسخگو باشند. با این حال، نگرانی هایی وجود دارد مبنی بر این که برخی از سیستم های هوش مصنوعی ممکن است شفاف نباشند و بررسی یا ممیزی آن دشوار باشد.

7. خطر نابودی بشریت

برخی از کارشناسان این نگرانی را مطرح کرده اند که توسعه هوش مصنوعی، چه از طریق توسعه هوش مصنوعی فوق هوشمند خارج از کنترل انسان و چه از طریق استفاده از هوش مصنوعی در بخش نظامی یا سایر روش های مخرب، می تواند خطر نابودی بشریت را در پی داشته باشد.

Bitcoin : $73827.82 0.1

Bitcoin : $73827.82 0.1  Ethereum : $2010.44 0.46

Ethereum : $2010.44 0.46  Tether USDt : $1

Tether USDt : $1  BNB : $713.31 0.07

BNB : $713.31 0.07  XRP : $1.34 0.26

XRP : $1.34 0.26  USDC : $1

USDC : $1  Solana : $82.49 0.01

Solana : $82.49 0.01  TRON : $0.35 1.01

TRON : $0.35 1.01  Hyperliquid : $72.51 7.5

Hyperliquid : $72.51 7.5  Dogecoin : $0.1 0.1

Dogecoin : $0.1 0.1  Zcash : $567.97 7.84

Zcash : $567.97 7.84  UNUS SED LEO : $10.03 0.46

UNUS SED LEO : $10.03 0.46  Stellar : $0.26 11.83

Stellar : $0.26 11.83  Cardano : $0.24 0.1

Cardano : $0.24 0.1  Monero : $365.45 0.73

Monero : $365.45 0.73  Chainlink : $9.14 0.3

Chainlink : $9.14 0.3  Bitcoin Cash : $302.58 0.07

Bitcoin Cash : $302.58 0.07  Canton : $0.16 1.47

Canton : $0.16 1.47  Dai : $1

Dai : $1  Toncoin : $1.89 4.11

Toncoin : $1.89 4.11